De voor(oor)delen van data en algoritmes

Over het onderwerp data en algoritmes is al heel veel geschreven. Sinds de hype rondom Artificial Intelligence zijn de blogs over dit onderwerp alleen maar toegenomen en ook op tv zijn er genoeg documentaires. Dus wat kan ik nog toevoegen aan dit onderwerp?

Verband of toeval?

Per toeval kwam ik onlangs op de volgende website terecht: http://www.tylervigen.com/spurious-correlations. Bij het zien van deze website wist ik het: mijn eerste blog gaat over het interpreteren en de vooroordelen van data en algoritmes.

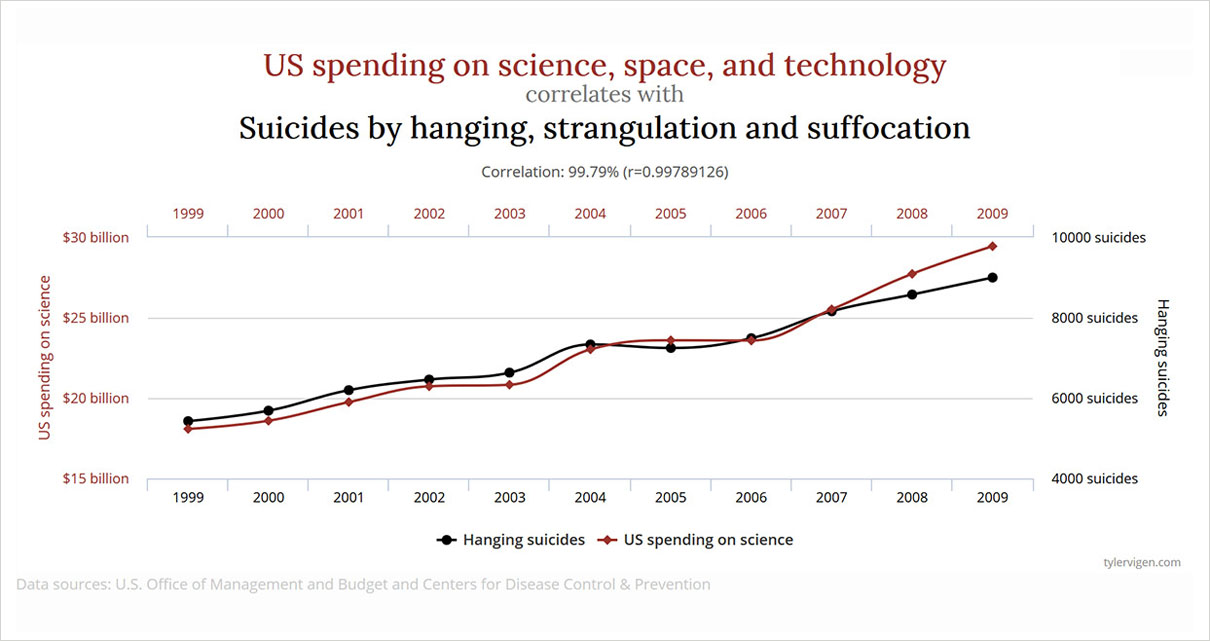

De website laat een paar mooie voorbeelden zien van twee totaal verschillende datasets die op het oog een duidelijke correlatie hebben. Zo zou je op basis van het onderstaande lugubere voorbeeld kunnen concluderen dat hoe meer de VS besteedt aan wetenschap, ruimtevaart & technologie, hoe meer mensen zelfmoord plegen door verhanging, wurging en verstikking. Op basis van dit ‘verband’ kun je senatoren en nieuwszenders al bijna horen roepen zo snel mogelijk minder geld uit te geven om zo het aantal zelfmoorden terug te dringen.

Hoewel de lijntjes over elkaar lopen (correlatie), wil dat niet zeggen dat de ene gebeurtenis de andere veroorzaakt (causatie). Causatie is statistisch erg lastig aan te tonen, maar vaak wordt deze conclusie toch getrokken, gebaseerd op wat men graag zou willen concluderen. Maar als je logisch nadenkt en je gezond verstand gebruikt, dan weet (hopelijk) iedereen dat dit verband puur toeval is.

Discriminerende algoritmes

Tijdens mijn studie leerde ik dat wiskunde neutraal is. Immers is 1+1 voor altijd en iedereen 2 en een wiskundig bewijs klopt of klopt niet. Maar in het boek Weapons of Math Destruction beschrijft Cathy O’Neil onder andere dat ook wiskundige algoritmes bevooroordeeld zijn.

Een voorbeeld hiervan zijn de modellen die in de VS worden gebruikt om de kans te bepalen dat iemand herhaaldelijk crimineel gedrag zal vertonen. Als iemand wordt geclassificeerd als ‘hoog risico’, dan zal deze persoon waarschijnlijk een langere straf krijgen en meer moeite hebben om een baan te vinden wanneer hij of zij vrijkomt. Deze persoon zal daardoor wellicht eerder geneigd zijn weer crimineel gedrag te vertonen. Zo lijkt het alsof het model het goed heeft voorspeld. Zo bleek ook dat software die in de Amerikaanse staat Florida wordt gebruikt om het recidiverisico van gevangenen in te schatten, bevooroordeeld was tegenover zwarte mensen.

Daarnaast beschrijft O’Neil dat algoritmes niet objectief zijn, maar ‘meningen verpakt in wiskunde’. Denk je bijvoorbeeld dat klimaatverandering niet bestaat? Dan zal dit ook de modellen beïnvloeden die gebruikt worden om het klimaat te voorspellen.

Wees daarom kritisch bij zowel het interpreteren van de uitkomsten van een model als bij het opstellen van een model.

De toekomst van data en algoritmes

De laatste paar jaar hoor je steeds vaker dat algoritmes de toekomst hebben. Daar geloof ik zelf ook zeker in. Denk alleen al aan de zelfrijdende auto en de Amazon Go-winkel zonder kassa’s.

Maar zoals bovenstaande voorbeelden hopelijk ook laten zien, zijn zowel data-analyse als algoritmen slechts gereedschappen die worden ingezet door mensen. Dit betekent dat ze (bewust of onbewust) verkeerd kunnen worden gebruikt. En de uitkomsten zijn deels een afspiegeling van de doeleinden van de mensen die deze gereedschappen gebruiken.

Daarom is het noodzakelijk om kritisch te zijn op de uitkomsten, logisch na te denken en je bewust te zijn van je eigen vooroordelen bij het inzetten van deze methoden.